Fordele, ulemper og trade-offs ved Vercel AI SDK opdateres med native agent-support og RAG-integration

Fordele, ulemper og trade-offs ved Vercel AI SDK opdateres med native agent-support og RAG-integration

Vercel AI SDK opdateres med native agent-support og RAG-integration repræsenterer et betydeligt skridt fremad for udviklere, der arbejder med AI-drevne applikationer. Den nye funktionalitet gør det muligt at bygge intelligente agenter direkte i SDK'et, samtidig med at Retrieval-Augmented Generation (RAG) nu er indbygget som en kernefunktion.

For beslutningstagere betyder dette, at time-to-market for AI-projekter kan reduceres markant. I stedet for at skulle integrere separate biblioteker og håndtere kompleks konfiguration, kan teams nu fokusere på forretningslogik og brugeroplevelse.

Opdateringen kommer dog med tekniske trade-offs, som kræver grundig overvejelse. Performance-overhead fra RAG-integration kan påvirke responstider, særligt ved store datasæt eller komplekse queries.

Typiske forventninger vs. realiteter

Mange teams forventer, at native agent-support automatisk løser alle AI-relaterede udfordringer. Realiteten er, at arkitekturen stadig kræver omhyggelig planlægning og forståelse af dataflow mellem agenter og RAG-komponenter.

En typisk fejltagelse er at undervurdere behovet for data-preprocessing og prompt-engineering. Selv med native support skal teams investere tid i at optimere deres knowledge base og fine-tune agent-adfærd til specifikke use cases.

Vores udviklere arbejder med de nyeste teknologier og kan hurtigt sætte sig ind i jeres stack, så I får værdi fra dag ét. Dette gælder særligt ved implementation af Vercel AI SDK opdateres med native agent-support og RAG-integration, hvor erfaring med både frontend og backend integration er afgørende.

Hvem bør overveje det?

Teams med eksisterende Next.js-applikationer og behov for conversational AI vil få størst værdi. Særligt e-commerce platforme, kundeservice-systemer og content management løsninger kan drage fordel af den integrerede tilgang.

Organisationer med begrænset AI-ekspertise bør være forsigtige. Selvom SDK'et forenkler implementation, kræver optimal performance stadig dyb forståelse af machine learning principper og data engineering.

Vi er et IT-konsulenthus bestående af fullstack-udviklere, og vores prioritering er at hjælpe dig netop dér, hvor du er. Dette betyder, at vi kan vurdere jeres nuværende setup og anbefale den mest hensigtsmæssige tilgang til AI-integration.

Typiske use cases og valgkriterier

Vercel AI SDK opdateres med native agent-support og RAG-integration åbner for flere konkrete anvendelsesmuligheder. Customer support chatbots kan nu kombinere real-time brugerdata med historiske samtaler for mere kontekstuelle svar.

Content discovery systemer kan implementere intelligent søgning, hvor agenter forstår brugerintention og leverer personaliserede resultater baseret på RAG-drevne anbefalinger. Dette er særligt værdifuldt for medieplatforme og e-learning systemer.

Dokumentationssystemer kan automatisere svar på tekniske spørgsmål ved at kombinere kodebaser med eksisterende dokumentation. Agenten kan analysere kode-context og generere præcise, opdaterede svar.

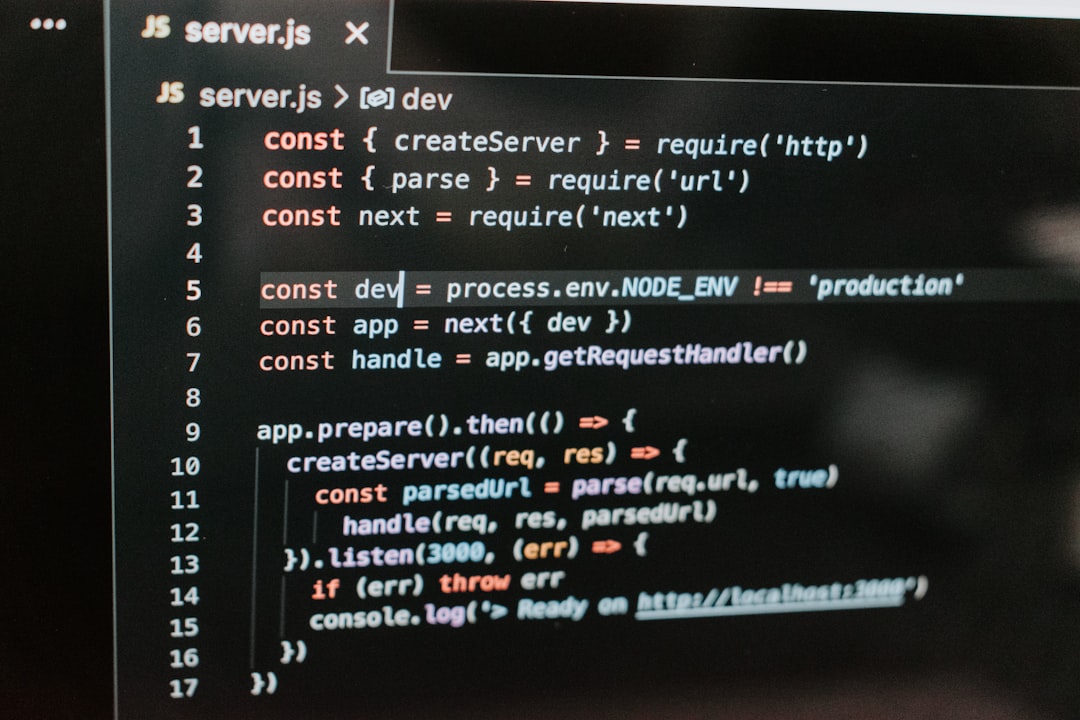

Arkitektur & integration

Successful implementation kræver omhyggelig planlægning af dataflow mellem frontend, agent-layer og RAG-komponenter. Vector databases skal dimensioneres korrekt for at håndtere både læse- og skrive-operationer effektivt.

Integration med eksisterende teknologier som C# backend-services eller Node.js APIs kræver særlig opmærksomhed på latency og error handling. Cross-service kommunikation skal designes med fallback-mekanismer.

Vi starter med en snak om jeres projekt: hvad skal laves, og hvilke mål har I? På opstartsmødet stiller vi de nødvendige spørgsmål, afklarer tekniske muligheder og får styr på forventningerne.

Sikkerhed & compliance

RAG-integration introducerer nye sikkerhedsovervejelser, særligt omkring data privacy og access control. Sensitive dokumenter i knowledge base skal beskyttes mod unauthorized access gennem agent queries.

GDPR-compliance bliver kompleks, når persondata indgår i RAG-pipelines. Data retention policies skal implementeres både for vector embeddings og conversation history.

Rate limiting og input validation bliver kritiske for at forhindre prompt injection attacks og resource exhaustion. Monitoring af agent-adfærd skal implementeres for at detektere unormal usage patterns.

- Implementer robust authentication og authorization for agent endpoints

- Etabler data governance policies for RAG knowledge base opdateringer

- Design comprehensive logging for audit trails og debugging

- Konfigurer automated testing for agent responses og RAG accuracy

- Planlæg skalering af vector database infrastructure

Direkte samarbejde med udviklere betyder, at du arbejder altid direkte sammen med en udvikler, når du arbejder sammen med os. Vi undgår dyre administrationsudgifter og fokuserer på effektivitet, hvilket er særligt værdifuldt ved komplekse AI-implementationer.

Vi kan indgå som en ekstra hånd i jeres udviklingsteam – eller tage ansvar for hele projekter fra idé til levering. Dette gælder også for Vercel AI SDK opdateres med native agent-support og RAG-integration, hvor vi kan hjælpe med både arkitektur, implementation og optimering.

Successful adoption af Vercel AI SDK opdateres med native agent-support og RAG-integration kræver både teknisk ekspertise og strategisk planlægning. Teams bør starte med pilot-projekter for at forstå performance-karakteristika og optimeringsmuligheder, før de skalerer til production-miljøer.

Har I brug for hjælp til at vurdere, om denne teknologi passer til jeres use case? Find konsulent hos os, og lad os tage en uforpligtende snak om jeres specifikke behov og muligheder.

Seneste blogindlæg

Vi har skrevet en stor række af indlæg omkring udvikling af projekter. Dyk ned i dem og har du spørgsmål, så kontakt os endelig.